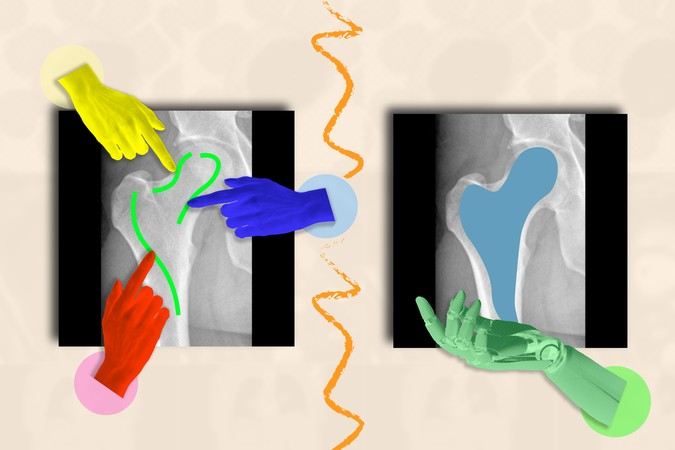

“ScribblePrompt”, farklı tıbbi taramalardaki anatomik yapıları etkili bir şekilde vurgulayabilen ve tıbbi çalışanların ilgi alanlarını ve anormallikleri belirlemesine yardımcı olan etkileşimli bir yapay zeka çerçevesidir.

Eğitimsiz bir göz için, MRI veya X-ışını gibi tıbbi bir görüntü, siyah beyaz lekelerin bulanık bir koleksiyonu gibi görünür. Bir yapının (örneğin bir tümör) nerede bittiğini ve diğerinin nerede başladığını çözmek zor olabilir.

Biyolojik yapıların sınırlarını anlamak üzere eğitildiklerinde, AI sistemleri doktorların ve biyomedikal çalışanların hastalıkları ve diğer anormallikleri izlemek istedikleri ilgi bölgelerini segmentlere ayırabilir (veya çizebilir). Birçok görüntüde anatomiyi elle izleyerek değerli zaman kaybetmek yerine, yapay bir asistan bunu onlar için yapabilir. İşin

püf noktası mı? Araştırmacılar ve klinisyenler, AI sistemlerini doğru bir şekilde segmentlere ayırabilmeleri için eğitmek amacıyla sayısız görüntüyü etiketlemelidir. Örneğin, denetlenen bir modeli korteksin şeklinin farklı beyinlerde nasıl değişebileceğini anlaması için eğitmek amacıyla serebral korteksi çok sayıda MRI taramasında açıklamanız gerekir.

Bu tür sıkıcı veri toplamayı bir kenara bırakarak, MIT Bilgisayar Bilimi ve Yapay Zeka Laboratuvarı (CSAIL), Massachusetts Genel Hastanesi (MGH) ve Harvard Tıp Fakültesi’nden araştırmacılar, etkileşimli ” ScribblePrompt ” çerçevesini geliştirdiler: daha önce görülmemiş türler dahil olmak üzere herhangi bir tıbbi görüntüyü hızla segmentlere ayırmaya yardımcı olabilen esnek bir araç.

İnsanların her resmi manuel olarak işaretlemesi yerine, ekip kullanıcıların gözlerdeki, hücrelerdeki, beyinlerdeki, kemiklerdeki, ciltteki ve daha fazlasındaki yapılar arasında MRI’lar, ultrasonlar ve fotoğraflar dahil olmak üzere 50.000’den fazla taramayı nasıl ek açıklama ekleyeceğini simüle etti. Ekip, tüm bu taramaları etiketlemek için, insanların tıbbi görüntülerdeki farklı bölgeleri nasıl karalayacağını ve tıklayacağını simüle eden algoritmalar kullandı. Ekip, yaygın olarak etiketlenen bölgelere ek olarak, benzer değerlere sahip görüntü parçalarını bulan süper piksel algoritmaları da kullanarak tıbbi araştırmacılar için potansiyel olarak yeni ilgi alanları belirledi ve ScribblePrompt’u bunları segmentlere ayırması için eğitti. Bu sentetik veriler, ScribblePrompt’u kullanıcıların gerçek dünya segmentasyon isteklerini işlemeye hazırladı. MIT doktora öğrencisi Hallee Wong SM ’22, ScribblePrompt ve CSAIL iştiraki hakkında yeni

bir makalenin baş yazarı, “AI, insanların daha üretken bir şekilde iş yapmasına yardımcı olmak için görüntüleri ve diğer yüksek boyutlu verileri analiz etmede önemli bir potansiyele sahip” diyor . “Etkileşimli bir sistem aracılığıyla tıbbi çalışanların çabalarını değiştirmek değil, artırmak istiyoruz. ScribblePrompt, doktorların analizlerinin daha ilgi çekici kısımlarına odaklanmalarına yardımcı olacak verimliliğe sahip basit bir modeldir. Örneğin, Meta’nın Segment Anything Model (SAM) çerçevesine kıyasla açıklama süresini %28 oranında azaltarak, karşılaştırılabilir etkileşimli segmentasyon yöntemlerinden daha hızlı ve daha doğrudur.”

ScribblePrompt’un arayüzü basittir: Kullanıcılar, bölümlenmesini istedikleri kaba alanın üzerine karalama yapabilir veya üzerine tıklayabilir ve araç, istendiğinde tüm yapıyı veya arka planı vurgulayacaktır. Örneğin, bir retina (göz) taramasındaki tek tek damarlara tıklayabilirsiniz. ScribblePrompt ayrıca, sınırlayıcı bir kutu verildiğinde bir yapıyı işaretleyebilir.

Daha sonra, araç kullanıcının geri bildirimlerine göre düzeltmeler yapabilir. Bir ultrasonda bir böbreği vurgulamak isterseniz, sınırlayıcı bir kutu kullanabilir ve ardından ScribblePrompt herhangi bir kenarı kaçırırsa yapının ek kısımlarını karalayabilirsiniz. Segmentinizi düzenlemek isterseniz, belirli bölgeleri hariç tutmak için “olumsuz karalama” kullanabilirsiniz.

Bu kendi kendini düzelten, etkileşimli yetenekler, ScribblePrompt’u bir kullanıcı çalışmasında MGH’deki nörogörüntüleme araştırmacıları arasında tercih edilen araç haline getirdi. Bu kullanıcıların %93,8’i, karalama düzeltmelerine yanıt olarak segmentlerini iyileştirmede SAM temel çizgisine göre MIT yaklaşımını tercih etti. Tıklamaya dayalı düzenlemelere gelince, tıp araştırmacılarının %87,5’i ScribblePrompt’u tercih etti.

ScribblePrompt, göz, göğüs, omurga, hücreler, cilt, karın kasları, boyun, beyin, kemikler, dişler ve lezyonların taramalarını içeren 65 veri kümesindeki 54.000 görüntüde simüle edilmiş karalamalar ve tıklamalar üzerinde eğitildi. Model, mikroskopi, BT taramaları, X-ışınları, MRI’lar, ultrasonlar ve fotoğraflar dahil olmak üzere 16 tür tıbbi görüntüyle tanıştı.

“Mevcut yöntemlerin çoğu, kullanıcılar görüntüler üzerinde karalama yaptığında iyi yanıt vermiyor çünkü eğitimde bu tür etkileşimleri simüle etmek zor. ScribblePrompt için, sentetik segmentasyon görevlerimizi kullanarak modelimizin farklı girdilere dikkat etmesini zorlayabildik” diyor Wong. “Esasında bir temel modeli çok çeşitli veriler üzerinde eğitmek istedik, böylece yeni türdeki görüntülere ve görevlere genelleştirilebilirdi.”

Bu kadar çok veriyi aldıktan sonra ekip, ScribblePrompt’u 12 yeni veri kümesinde değerlendirdi. Bu görüntüleri daha önce görmemiş olmasına rağmen, daha verimli bir şekilde segmentasyon yaparak ve kullanıcıların vurgulanmasını istediği kesin bölgeler hakkında daha doğru tahminler sunarak dört mevcut yöntemi geride bıraktı.

“Segmentasyon, hem rutin klinik uygulamada hem de araştırmada yaygın olarak gerçekleştirilen en yaygın biyomedikal görüntü analiz görevidir – bu da hem çok çeşitli hem de kritik, etkili bir adım olmasına yol açar,” diyor kıdemli yazar Adrian Dalca SM ’12, PhD ’16, CSAIL araştırma bilimcisi ve MGH ve Harvard Tıp Fakültesi’nde yardımcı doçent. “ScribblePrompt, klinisyenler ve araştırmacılar için pratik olarak yararlı olacak şekilde dikkatlice tasarlandı ve dolayısıyla bu adımı önemli ölçüde çok, çok daha hızlı hale getirdi.”

Harvard Tıp Fakültesi radyoloji profesörü ve MGH sinirbilimci Bruce Fischl, makalede yer almayan, “Görüntü analizi ve makine öğreniminde geliştirilen segmentasyon algoritmalarının çoğu, en azından bir dereceye kadar görüntüleri manuel olarak açıklama yeteneğimize dayanmaktadır,” diyor. “Sorun, ‘görüntülerimizin’ tipik olarak 3B hacimler olduğu tıbbi görüntülemede önemli ölçüde daha kötüdür, çünkü insanların 3B görüntüleri açıklama konusunda herhangi bir yeterliliğe sahip olmaları için evrimsel veya fenomenolojik bir nedenleri yoktur. ScribblePrompt, bir ağın, bir insanın elle açıklama yaparken tipik olarak bir görüntüyle sahip olacağı etkileşim türleri konusunda eğitilmesiyle, elle açıklamanın çok daha hızlı ve doğru bir şekilde gerçekleştirilmesini sağlar. Sonuç, açıklama yapanların daha önce mümkün olandan çok daha fazla üretkenlikle görüntü verileriyle doğal olarak etkileşime girmesini sağlayan sezgisel bir arayüzdür.”

Wong ve Dalca makaleyi iki CSAIL iştirakiyle birlikte yazdı: MIT’de Dugald C. Jackson EECS Profesörü ve CSAIL baş araştırmacısı olan John Guttag; ve MIT doktora öğrencisi Marianne Rakic SM ’22. Çalışmaları kısmen Quanta Computer Inc., Broad Enstitüsü’ndeki Eric ve Wendy Schmidt Merkezi, Wistron Corp. ve Ulusal Sağlık Enstitüleri’nin Ulusal Biyomedikal Görüntüleme ve Biyomühendislik Enstitüsü tarafından desteklendi ve Massachusetts Yaşam Bilimleri Merkezi’nden donanım desteği aldı.

Wong ve meslektaşlarının çalışmaları 2024 Avrupa Bilgisayar Görüntüsü Konferansı’nda sunulacak ve bu yılın başlarında Bilgisayar Görüntüsü ve Desen Tanıma Konferansı’ndaki DCAMI çalıştayında sözlü konuşma olarak sunuldu. ScribblePrompt’un potansiyel klinik etkisi için çalıştayda Tezgahtan Yatağa Makale Ödülü’ne layık görüldüler.